Social media en de kwetsbaarheid van vrijheid

-

Foto: Tom Hessels

Foto: Tom Hessels

Social media zijn per definitie seksistisch en racistisch. Dat is een van de conclusies van een Social Sorting Experiment dat donderdagavond door Radboud Reflects werd georganiseerd. ‘Het probleem is dat we geen overzicht hebben van alle informatie die we in het systeem stoppen.’

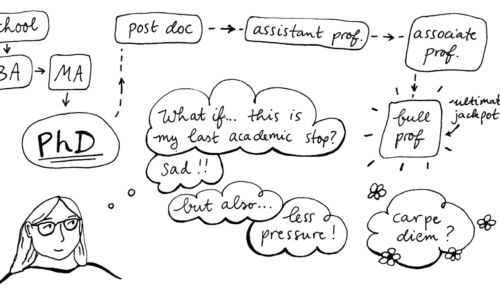

Het is een doorsnee donderdagavond op de campus, kwart voor acht. Het moment waarop de laatste colleges en werkgroepen net zijn afgelopen, de meeste kantoren zijn gesloten en de laatste dienbladen bij de Refter weer zijn opgeruimd. Terwijl de campus begint leeg te lopen, stroomt een vijftigtal mensen juist theaterzaal C binnen. Zij zijn hier voor deelname aan een experiment.

Het zogenaamde Social Sorting Experiment om precies te zijn. Dit experiment, dat georganiseerd werd door Radboud Reflects en uitgevoerd door The Smartphone Orchestra, moet het concept social media tot leven brengen. En hier is niet veel voor nodig: een genummerd patroon op de vloer en een enorme hoeveelheid telefoonschermen, waar steeds een deelnemer aan is verbonden. Dat is echter voldoende om een benauwende sfeer te creëren.

Vragenlijst

Zodra het experiment is begonnen, lijkt iedereen de campus te hebben verlaten en zo een aflevering van Black Mirror te zijn binnengestapt. De deelnemers staan op een genummerd vakje in het patroon, zo dicht op elkaar dat ze zich in elkaars persoonlijke ruimte bevinden. En dat is precies de bedoeling. De deelnemers moeten oncomfortabel dicht op elkaar staan, en afwisselend hun hoofd richting hun telefoon buigen in afwachting van instructies en andere deelnemers observeren, die zich op slechts een paar centimeter afstand bevinden, die ze op allerlei punten moeten beoordelen.

Het experiment is fysiek net zo oncomfortabel als dat digitale tegenhangers als Instagram en Facebook ons zouden moeten laten voelen. Die zijn tenslotte op hetzelfde concept gebaseerd: een voortdurende beoordeling van eerste indrukken die in het big-datanetwerk worden ingevoerd. Een netwerk dat vervolgens content presenteert op basis van voorkeuren die zijn vastgesteld aan de hand van eerdere beoordelingen. Het is een psychologische vragenlijst die iedereen voortdurend invult. De grootste dataverzameling van allemaal, gebruikt om likes uit het verleden te versterken.

Beslissingen

’Waarom is dat een probleem?’, vraagt een van de deelnemers achteraf. Het probleem is volgens Fleur Jongepier, universitair docent gespecialiseerd in cyberethiek en een van de sprekers die zijn uitgenodigd om naderhand een praatje te houden, dat we geen overzicht hebben van alle informatie die we in dat systeem stoppen. Een systeem dat op basis van algoritmes werkt, zegt Jongepier, die niet neutraal zijn, omdat de mensen die ze gebouwd hebben dat ook niet zijn.

Die vooringenomenheid is heel menselijk, vult Rob Holland aan, bijzonder hoogleraar Sociale Psychologie, die tevens is uitgenodigd om te spreken. Dit helpt ons in het dagelijks leven te functioneren. Vooringenomenheid kan echter ook tot vooroordelen en schade leiden als we niet bewust gecorrigeerd worden in bepaalde situaties. Iets wat, benadrukt Jongepier, algoritmes niet doen, waardoor ze in per definitie seksistisch en racistisch zijn. En die algoritmes bepalen welke informatie we ontvangen en beïnvloeden zo uiteindelijk de beslissingen die we nemen.

Het evenement was bedoeld om bewustzijn voor dit probleem te genereren, maar het laat tevens zien dat we nog altijd niet dichter bij een oplossing zijn. Social media maken deel uit van een dystopische toekomst in wording, maar ze spelen ook overduidelijk een belangrijke rol in ons leven. En terwijl de data die hierop worden ingevoerd en de informatie die we op basis daarvan ontvangen belangrijke maatschappelijke opvattingen beïnvloeden, wordt het steeds moeilijker om los te komen van die netwerken.

Algoritmes

Zo’n gevecht, zegt Jongepier, is bijna niet te winnen door individuen. Niet veel mensen hebben de tijd om een rechtszaak tegen Facebook aan te spannen en zonder WhatsApp kun je in 2020 eigenlijk bijna niet meer met elkaar communiceren. Volgens Jongepier moeten wetgevers hun verantwoordelijkheid nemen en ervoor zorgen dat deze bedrijven geen data kunnen verzamelen en verkopen in de mate waarin ze dat nu doen. En wel zo snel mogelijk.

Het experiment werd georganiseerd in het licht van vijfenzeventig jaar vrijheid. Toch zal dit niet de benodigde aanpassingen opleveren om de risico’s die aan dit onderwerp kleven echt te beperken. Mensen gaan naar huis en checken hun Instagram en versturen WhatsApp-berichten, maar overheden veranderen niet zomaar, en Facebook evenmin. Zo blijven we algoritmes van data voorzien, wat vooringenomenheid in stand zal houden. ‘Het is niet alleen maar slecht’, zoals Jongepier stelde aan het einde van de avond, maar het is zeker een teken dat veel mensen lijken te zijn vergeten hoe kwetsbaar vrijheid kan zijn.