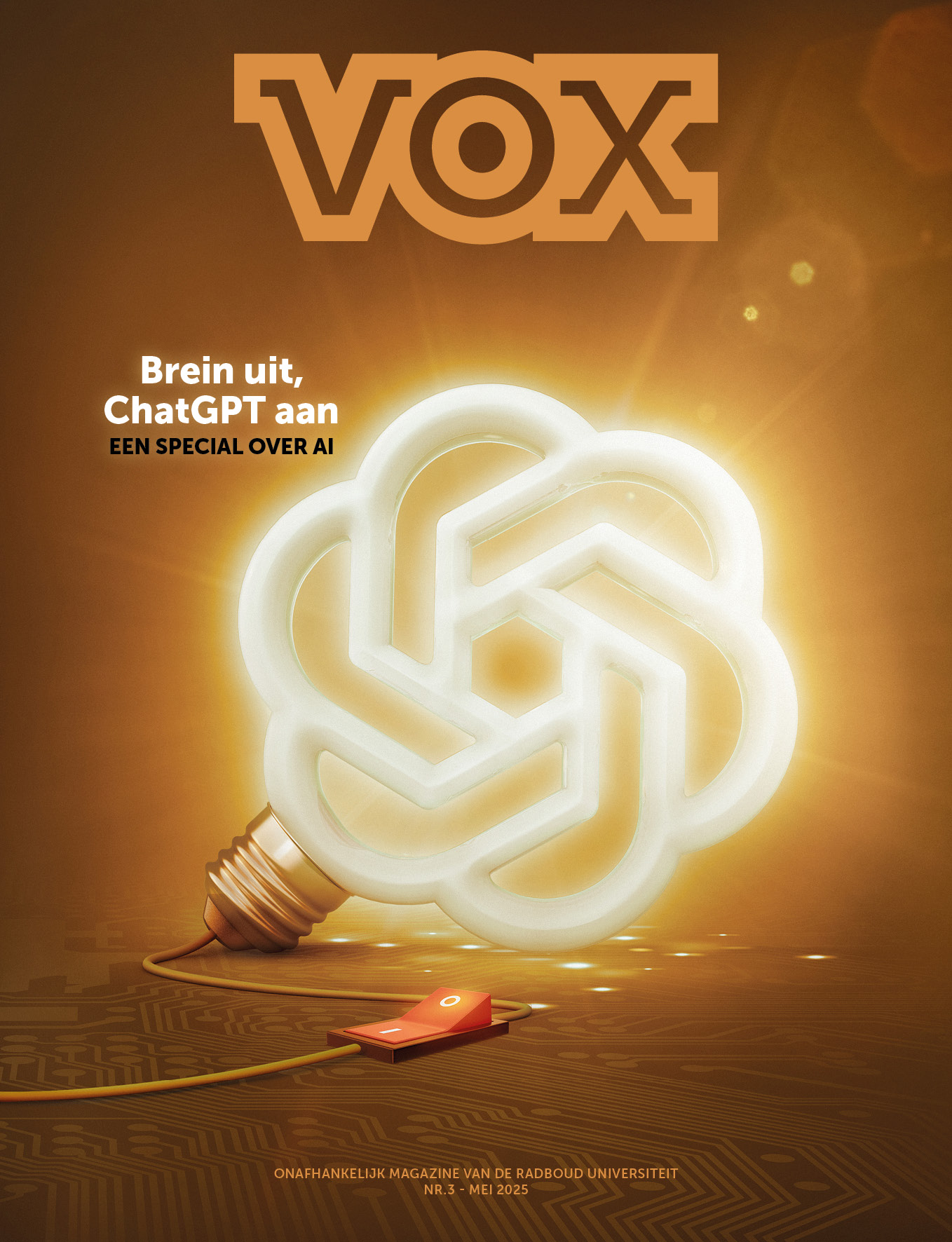

Hoe AI het onderwijs op z’n kop zet: ‘Misschien leidt het wel tot de terugkeer van mondelinge tentamens’

-

Illustratie: Debby Peeters

Illustratie: Debby Peeters

Veel studenten zetten chatbots als ChatGPT veelvuldig in bij hun studie. Wat betekent dat voor hun kritisch denkvermogen en de manier van toetsing?

Voor sociologiestudent Sven Braster is ChatGPT een uitkomst. ‘Ik ben hartstikke dyslectisch en gebruik de tool als taal- en spellingscheck. Ik vraag bijvoorbeeld hoe ik een zelfgeschreven tekst kan verbeteren.’

Nieuwe Vox

Dit artikel komt uit de nieuwe Vox, die volledig in het teken staat van AI. In dit magazine lees je alles over de invloed van kunstmatige intelligentie op onderwijs, wetenschap en studentenleven. Wist je dat ChatGPT bijvoorbeeld heel interessante ideeën heeft voor een studentikoos dagje Nijmegen? Maar niet iedereen is fan: drie studenten vertellen dat ze juist niks moeten hebben van AI-tools. Ze proberen, zo goed en kwaad als dat kan, AI niet te laten doordringen in hun dagelijkse levens.

Braster, ook voorzitter van de Universitaire Studentenraad, gebruikt AI niet alléén voor het verbeteren van zijn schrijfwerk. ‘Onlangs had ik een tentamen wetenschapsfilosofie. Dat ging onder andere over de filosoof Karl Popper. Ik vraag ChatGPT tijdens het studeren dan zijn kijk op de sociale wetenschappen uiteen te zetten.’ Met de uitkomst daarvan gaat Braster weer aan de slag. ‘Ik vat het samen in mijn eigen woorden om vervolgens weer aan ChatGPT te vragen of mijn samenvatting klopt.’

Studeren met behulp van de AI-chatbot is voor Braster een verdiepende manier om met de leerstof bezig te zijn. Of alle studenten ChatGPT zo gebruiken, betwijfelt hij. ‘Ik denk dat veel studenten het vooral gebruiken om werk bij zichzelf weg te nemen. Ergens heel logisch, het bespaart je tijd. Maar het ontneemt je ook wetenschappelijke inzichten en vaardigheden, zoals zelf verbanden leggen en argumenten bedenken. Als je ChatGPT inzet om je vragen te beantwoorden of om een essay te schrijven, leer je niet hoe je dat zelf doet.’

Geen consensus

Onderzoekers van het Radboud Teaching and Learning Centre (TLC) buigen zich sinds een aantal jaar over deze thematiek. Wat doet generatieve AI (ook wel afgekort tot GenAI) met de academische vaardigheden en het kritisch denkvermogen van studenten?

Het korte antwoord: er is nog geen wetenschappelijke consensus over. Daarvoor bestaan dit soort tools nog te kort. Uit voorlopige uitkomsten van wetenschappelijk onderzoek komt een wisselend beeld naar voren, zegt Jeroen de Jong, themaleider onderwijsinnovatie bij het TLC.

‘Nu vinden we het eindproduct vaak belangrijker dan het proces daarnaartoe’

Zo wijst een aantal studies op een negatieve invloed van GenAI-gebruik op het kritisch denkvermogen van studenten. Maar het tegenovergestelde wordt ook beweerd, merkte hoogleraar Filosofie van de gedragswetenschappen Jan Bransen onlangs tijdens een werkbezoek in Zweden. ‘Studenten van de universiteit van Göteborg bleken GenAI inderdaad veel te gebruiken, maar tot verrassing van de onderzoekers vooral om het eigen kritisch denkvermogen te versterken. Ze vroegen een chatbot bijvoorbeeld om meerdere versies van eenzelfde argument, zodat ze zelf konden kijken welke beter was.’

Toetsing

Door de chatbot moeten docenten in ieder geval anders gaan toetsen, denkt Bransen, die tevens academisch leider is van het TLC: ‘Vroeger kon je aan de hand van een thuisgemaakte schrijfopdracht opmaken of een student argumenten kon ontwikkelen om tot bepaalde conclusies te komen en dus een beetje georganiseerd kon denken. Nu kunnen die opdrachten net zo goed door ChatGPT zijn geschreven.’

Misschien leidt AI wel tot de terugkeer van mondelinge tentamens, oppert De Jong. ‘Eigenlijk was ik niet zo’n voorstander van de mondelinge verdediging van een thesis – uiteindelijk draait het toch om de tekst. Maar inmiddels zie ik toch het belang in van het toetsen van kennis op deze meer traditionele manier.’

Het moge duidelijk zijn: het zijn vooral de tekstuele opdrachten die onder de loep liggen. De Jong: ‘Ik denk dat we toegaan naar een situatie waarin studenten bijvoorbeeld explicieter moeten aangeven hoe ze AI hebben gebruikt. Of denk aan een cursus academische vaardigheden waarbij je de theorie over academisch schrijven thuis leert, maar het schrijven zelf in de klas doet. Met een docent in de buurt die jou op dat moment kan helpen.’

‘Wij zijn straks met pensioen, studenten niet’

Bransen: ‘Nu vinden we het eindproduct vaak belangrijker dan het proces daarnaartoe. Terwijl het leerproces vooral gaat over het formuleren van een goede onderzoeksvraag, het vinden van betrouwbare bronnen en het worstelen met woorden om je eigen argumenten goed op papier te zetten.’

Persoonlijker onderwijs

Om de leercurve van een student beter te kunnen volgen en te beïnvloeden, pleit Bransen voor meer persoonlijk onderwijs. ‘In plaats van één docent voor 400 studenten, moeten we naar meer contactonderwijs. In een gesprek met een student krijg je pas in de gaten of iemand zijn handelings- en oordeelsvermogen aan het ontwikkelen is. Daar gaat het om.’

Daar hoort volgens Bransen bij dat studenten meer mogen experimenteren met GenAI. ‘We zijn als universiteit geneigd om vanuit het perspectief van de docent en wetenschapper te kijken, maar wat vinden studenten zelf verantwoord AI-gebruik? Wij zijn straks met pensioen, zij moeten nog heel lang door op de arbeidsmarkt.’

Als studenten snappen waarom het belangrijk is om een goed lopende tekst te kunnen schrijven, willen de meesten dat waarschijnlijk ook wel leren, denkt de hoogleraar. ‘Als ze begrijpen dat hun eigen ontwikkeling centraal staat, dan kan ik me zelfs een veelvuldig gebruik van ChatGPT binnen de studie voorstellen. Zolang ze zich daar maar kritisch toe verhouden.’

Hierin kan student Braster zich uitstekend vinden. Hoewel hij veelvuldig gebruik maakt van ChatGPT, is dit niet zijn enige studeermethode. Bang dat hij de mist ingaat door foute antwoorden van de AI-tool is Braster dan ook niet. ‘Ik volgde voor wetenschapsfilosofie natuurlijk ook de colleges en de werkgroepen, en heb daar aantekeningen gemaakt en de literatuur gelezen. Ik had uiteindelijk een 7,5 voor het tentamen.’

Verantwoord AI-gebruik in de klas

Niet alleen de universiteit zit in haar maag met ChatGPT. Ook middelbare scholen peinzen over de vraag hoe het gebruik van AI in goede banen te leiden.

Met een langlopende subsidie van ruim 80 miljoen euro onderzoekt het Nationaal Onderwijslab AI (NOLAI) de inzet van kunstmatige intelligentie in het primair en voortgezet onderwijs. Vaak gaat het om het ontwikkelen en testen van handige AI-toepassingen, waarmee de leerkracht tijd kan besparen of meer maatwerk kan bieden in het individuele leerproces van kinderen (zie pagina 31, red.). Ook generatieve AI staat op de radar van de NOLAI-onderzoekers. De centrale vraag: hoe kan het voortgezet onderwijs de regie behouden over zowel leren als lesgeven met inzet van GenAI?

Onderzoeker Evi Topali verdiepte zich het afgelopen jaar in de pijnpunten en kansen van generatieve AI, en de mate van gebruik ervan door leerlingen en leerkrachten. Wat blijkt? Leerkrachten gebruiken GenAI onder andere om een nieuwe pedagogische theorie onder de knie te krijgen of om een lesonderdeel meer interactief te maken. In het klaslokaal daarentegen gebruiken ze GenAI meestal nog weinig, omdat ze moeilijk toezicht kunnen houden op wat leerlingen ermee doen. Haar onderzoek leert dat diezelfde leerlingen ChatGPT inmiddels hebben ontdekt. Ze gebruiken de tool om zich voor te bereiden op toetsen – door de chatbot vragen te laten stellen over het lesmateriaal – en om hun schrijfvaardigheid in een nieuwe taal te oefenen. Ook vragen ze ChatGPT regelmatig om suggesties voor het verbeteren van hun teksten.

Maar hoe ze dat precies doen, is niet goed uitgezocht, vertelt Topali. ‘Welke prompts gebruiken ze, kopiëren ze de antwoorden een-op-een of denken ze zelf nog kritisch na?’ Verbieden dan maar? Dat is geen goed idee, vinden Topali en haar collega Karmijn Steekelenburg, co-creatie manager bij NOLAI. Beter is om jongeren op een veilige en kritische manier met deze technologie te leren werken. ‘Zowel docenten als leerlingen moeten hiervoor nieuwe skills leren’, zegt Steekelenburg.

‘Het is van belang dat leerkrachten meer controle krijgen over GenAI’

Topali noemt het van belang om kinderen te begeleiden in het verantwoord gebruik van GenAI. ‘Nu gebruiken ze het in hun eentje om hun huiswerk te maken, waarbij ze soms de door AI gegenereerde antwoorden kopiëren. Terwijl die zeker niet altijd nauwkeurig zijn en soms ronduit fout. Het zou goed zijn als ze leren wat de voordelen en de risico’s zijn van GenAI.’ Daarnaast is het belangrijk dat leerkrachten meer controle krijgen over GenAI. De NOLAI-onderzoekers ontwikkelen daarom onderwijstools om leerkrachten bij te staan in een beschermde en gecontroleerde inzet van GenAI.

Met een van die tools kunnen docenten ‘achter de schermen’ meekijken hoe leerlingen in contact zijn met een chatbot. Een andere tool stelt de docent zelfs in staat om de antwoorden van AI te beïnvloeden. ‘GenAI-systemen geven vaak hallucinaties: dan genereert de chatbot incorrecte of niet-bestaande informatie’, legt Topali uit. ‘Daar spelen we mee. De leerkracht kan foute antwoorden geven, zodat de student gedwongen wordt om kritisch te zijn op de output.’

Henk schreef op 10 juni 2025 om 21:26

Ik vraag mij toch heel erg af wat deze mensen bedoelen met ‘verantwoord AI gebruik’. Dat wordt nooit uitgelegd, en in de tussentijd gaat iedereen het herhalen en erin geloven dat technologie neutraal is..

Het ontwikkelen van GenAI software kost bizar veel energie en water, mensen die in de buurt van de datacenters wonen kampen regelmatig met stroomstoringen en watertekort, er komt o.a. illegaal methaan vrij en de natuur rondom deze centers wordt stelselmatig vernietigd. Deze technologie versnelt de opwarming van onze planeet en dat terwijl we ook zonder AI afstevenen op minstens 3 graden opwarming.

Daarnaast is het materiaal (teksten, foto’s etc) om de technologie te ontwikkelen gejat en zonder toestemming gebruikt (zoveel over wetenschappelijke integriteit), worden duizenden werkers uitgebuit en getraumatiseerd tijdens het proces van data-labeling (moderne slavernij), en vooroordelen en misinformatie verspreid wat o.a. onze democratie ondermijnt. De output, en in het bijzonder samenvattingen, zitten vol fouten en laten de essentiële dingen weg. En dan hebben we het nog niet eens over het verdienmodel en machtsstructuren achter deze technologie die erop gericht zijn onze maatschappelijke waardes onderuit te halen.

Dit wetende, hoe kan het gebruik van deze technologie dan nog ‘verantwoord’ genoemd worden? Je mag zoveel GenAI gebruiken als je wilt, prima als je aan al deze ellende mee wilt werken. Maar hou op iedereen voor de gek te houden door het ‘verantwoord gebruik’ te noemen, dat bestaat niet. Net als dierenvriendelijk vlees niet bestaat, gezond roken niet bestaat, en milieuvriendelijk vliegen niet bestaat.

Sam schreef op 11 juni 2025 om 08:03

I find it quite irresponsible and bizarre to publish this whole article on ‘responsible’ use of AI without any mention of the environmental impacts, energy and water use, or big tech and data. I see the article is focusing on ‘responsible’ use only in the sense of educational impacts, but this is a very narrow approach and misses some of the most important reasons to avoid ChatGPT.

Juliette Alenda schreef op 11 juni 2025 om 09:44

It is quite incredible that, as usual, we are just engaging with this new technology without thinking twice about it. Talking about AI in education also requires talking about the huge impact on the environment, being about water, and the fact that they install data centers in places already pressured by the lack of water all over the world, (https://theconversation.com/ais-excessive-water-consumption-threatens-to-drown-out-its-environmental-contributions-225854, or being about energy, when we are already struggling to offer clean energy to all in a world dominated by fossil fuel interests (https://www.iea.org/news/ai-is-set-to-drive-surging-electricity-demand-from-data-centres-while-offering-the-potential-to-transform-how-the-energy-sector-works). This is also about colonialism (https://www.technologyreview.com/supertopic/ai-colonialism-supertopic/), human rights (https://www.amnesty.org/en/latest/campaigns/2024/01/the-urgent-but-difficult-task-of-regulating-artificial-intelligence/), data grabbing (https://blogs.lse.ac.uk/inequalities/2024/05/01/todays-colonial-data-grab-is-deepening-global-inequalities/), exploited workers (https://www.noemamag.com/the-exploited-labor-behind-artificial-intelligence/), and greed (https://www.nature.com/articles/d41586-024-04018-5).

Again, it would be important to take a step back as universities, considering our role in society and about educating people when it comes to the consequences of the decisions we make and the economy and technologies we want, without aggravating further the existing logics of exploitation of humans and nature.