De geest is uit de fles: hoe studenten en wetenschappers AI steeds meer omarmen

-

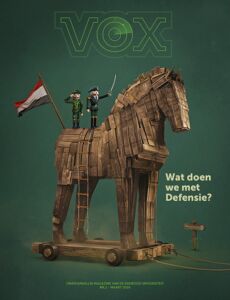

Illustratie: JeRoen Murré

Illustratie: JeRoen Murré

AI is niet meer weg te denken van de campus. Tools als ChatGPT maken het dagelijks leven van zowel studenten als wetenschappers makkelijker, blijkt uit een enquête van Vox. Hoe ver je daarbij mag gaan, is nog een punt van discussie. De universiteit werkt aan strakkere regels.

Wanneer Steven Trooster begin 2023 na de kerstvakantie terugkeert naar de campus, is van rustig opstarten geen sprake. Dat heeft alles te maken met de recente lancering van de publieke versie van ChatGPT. ‘Er was paniek in de tent’, herinnert de onderwijsadviseur zich. ‘Dit zou duidelijk grote gevolgen hebben voor het hoger onderwijs.’

Nieuwe Vox

Dit artikel komt uit de nieuwe Vox, die volledig in het teken staat van AI. In dit magazine lees je alles over de invloed van kunstmatige intelligentie op onderwijs, wetenschap en studentenleven. Wist je dat ChatGPT bijvoorbeeld heel interessante ideeën heeft voor een studentikoos dagje Nijmegen? Maar niet iedereen is fan: drie studenten vertellen dat ze juist niks moeten hebben van AI-tools. Ze proberen, zo goed en kwaad als dat kan, AI niet te laten doordringen in hun dagelijkse levens.

Niet veel later duiken de eerste verhalen op van studenten die hun papers met succes door de gratis chatbot van softwarebedrijf OpenAI laten schrijven. AI houdt de gemoederen op Nederlandse universiteiten sindsdien flink bezig, maar er is ook nog veel onbekend over dit nieuwe fenomeen. Is kunstmatige intelligentie nu een fundamentele bedreiging voor goed academisch onderwijs en onderzoek, of juist een ‘veelbelovend’ revolutionair hulpmiddel zoals de rekenmachine ooit was? En hoe vaak gebruiken studenten en wetenschappers programma’s als ChatGPT of Midjourney eigenlijk?

Vox zette een enquête uit om in kaart te brengen hoe hierover gedacht wordt op de Radboud Universiteit. Ruim 350 studenten en 130 wetenschappers vulden ieder een eigen vragenlijst in over AI-gebruik in onderwijs en onderzoek.

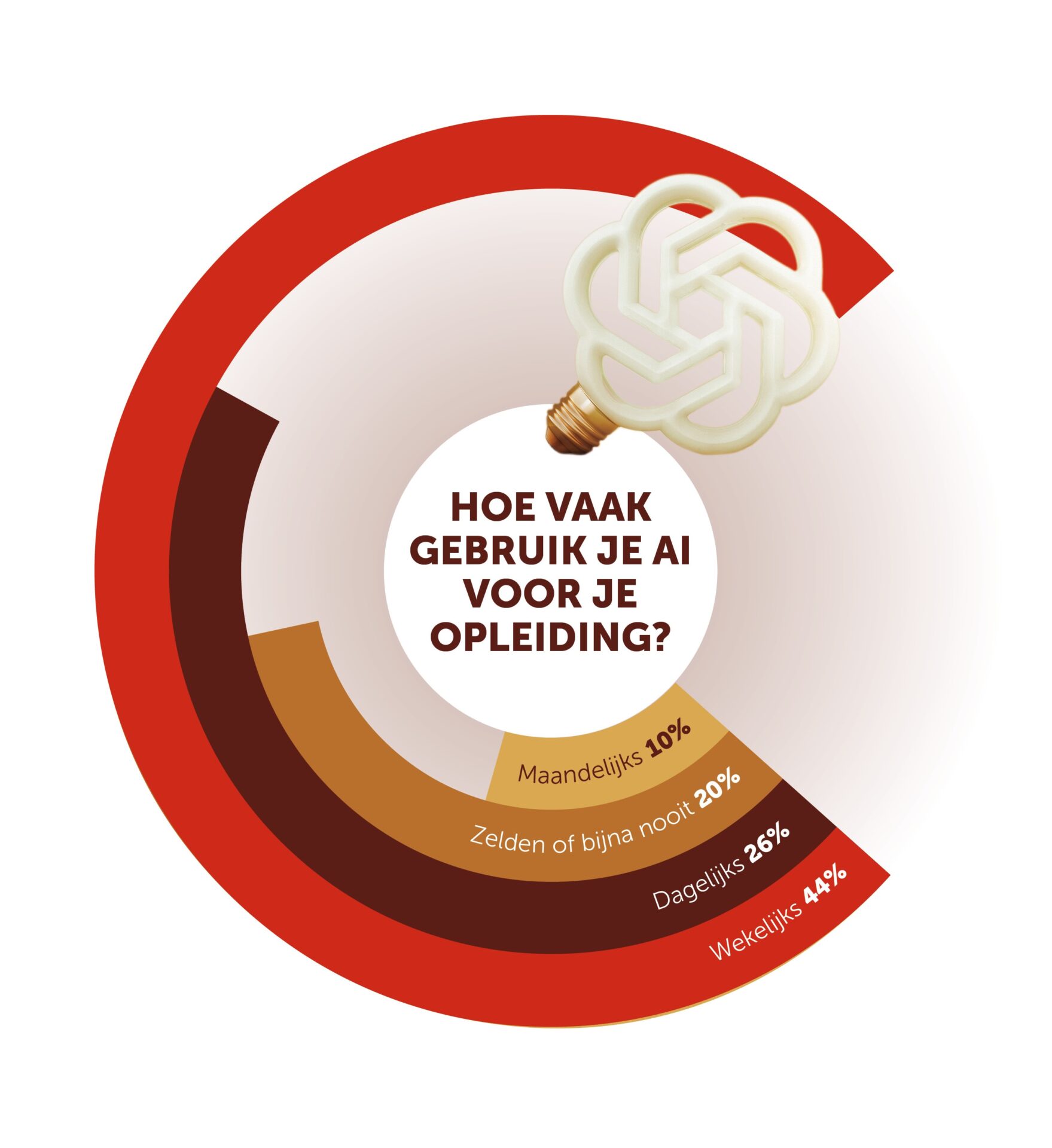

AI is behoorlijk ingeburgerd op de campus, zo blijkt 70 procent van de studenten gebruikt het een of meerdere keren per week. Die cijfers komen goed overeen met een AI-vaardigheidsonderzoek dat Radboud In’to Languages onlangs uitvoerde onder ruim 300 eerstejaarsstudenten van de Faculteit der Natuurwetenschappen, Wiskunde en Informatica (FNWI). Bijna twee derde van hen gebruikte AI regelmatig tot zeer vaak, een kwart zelden tot nooit.

Ook kloppen de percentages aardig met de inschattingen van wetenschappers die de enquête invulden. Van hen denkt een meerderheid dat ten minste driekwart van de studenten AI gebruikt voor de studie. Slechts 5 procent vermoedt dat minder dan een kwart dit doet. Zelf gebruikt de helft van de wetenschappers maandelijks of vaker AI.

ChatGPT is veruit de meest populaire tool. Zes op de zeven studenten en wetenschappers gebruiken dit large language model (LLM) wel eens. Andere zogeheten generatieve AI-programma’s als Perplexity, Gemini en Deepseek volgen op grote afstand (elk rond de 5 tot 10 procent).

ChatGPT is veruit de meest populaire tool. Zes op de zeven studenten en wetenschappers gebruiken dit large language model (LLM) wel eens. Andere zogeheten generatieve AI-programma’s als Perplexity, Gemini en Deepseek volgen op grote afstand (elk rond de 5 tot 10 procent).

Googelen

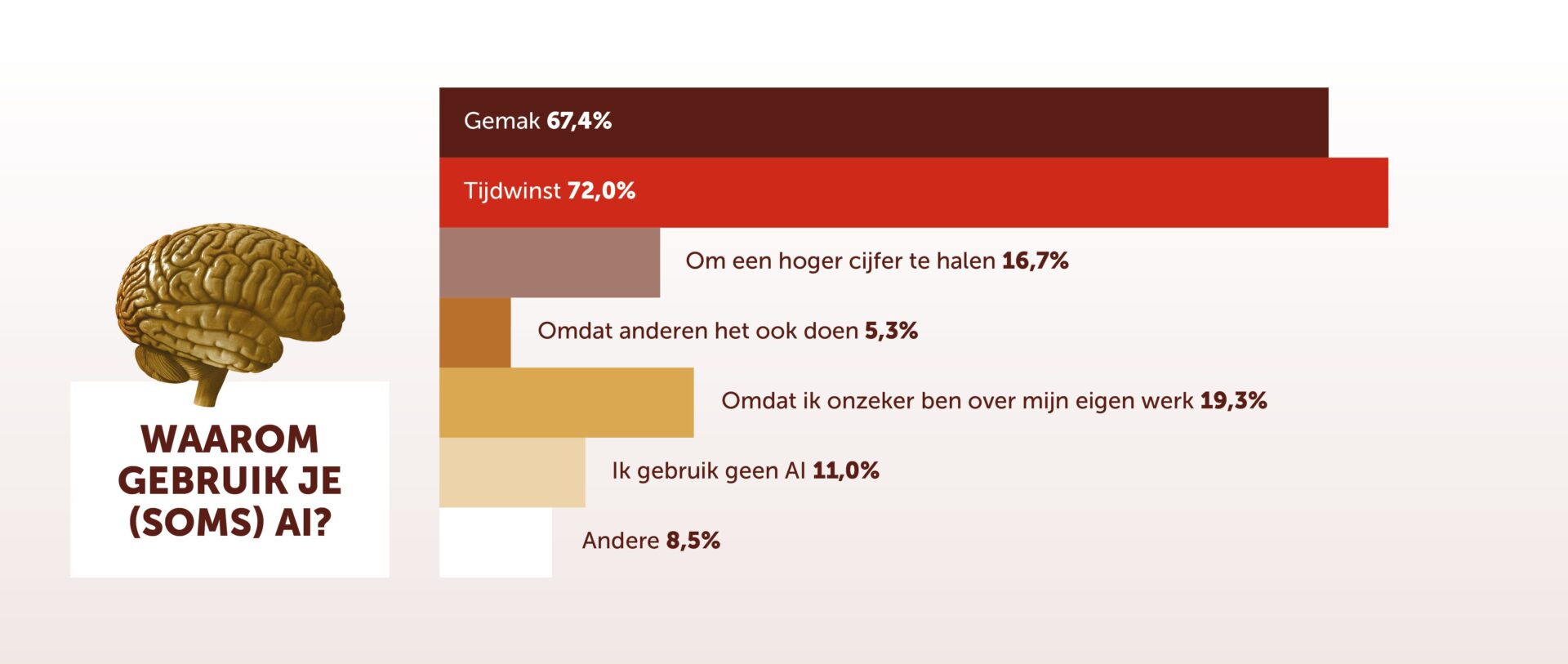

‘Tijdwinst’, ‘gemak’. Vraag studenten waarom ze AI gebruiken voor hun studie en deze antwoorden springen eruit. Twee derde vinkt deze aan als motieven. ’Ik zie het gewoon als iets googelen, maar efficiënter’, schrijft een student in een toelichting. ‘Het lezen van een door AI gemaakte samenvatting kan helpen bij het begrip van een tekst’, vindt een andere student. Slechts een op de zes studenten gebruikt ChatGPT met het doel hogere cijfers te halen.

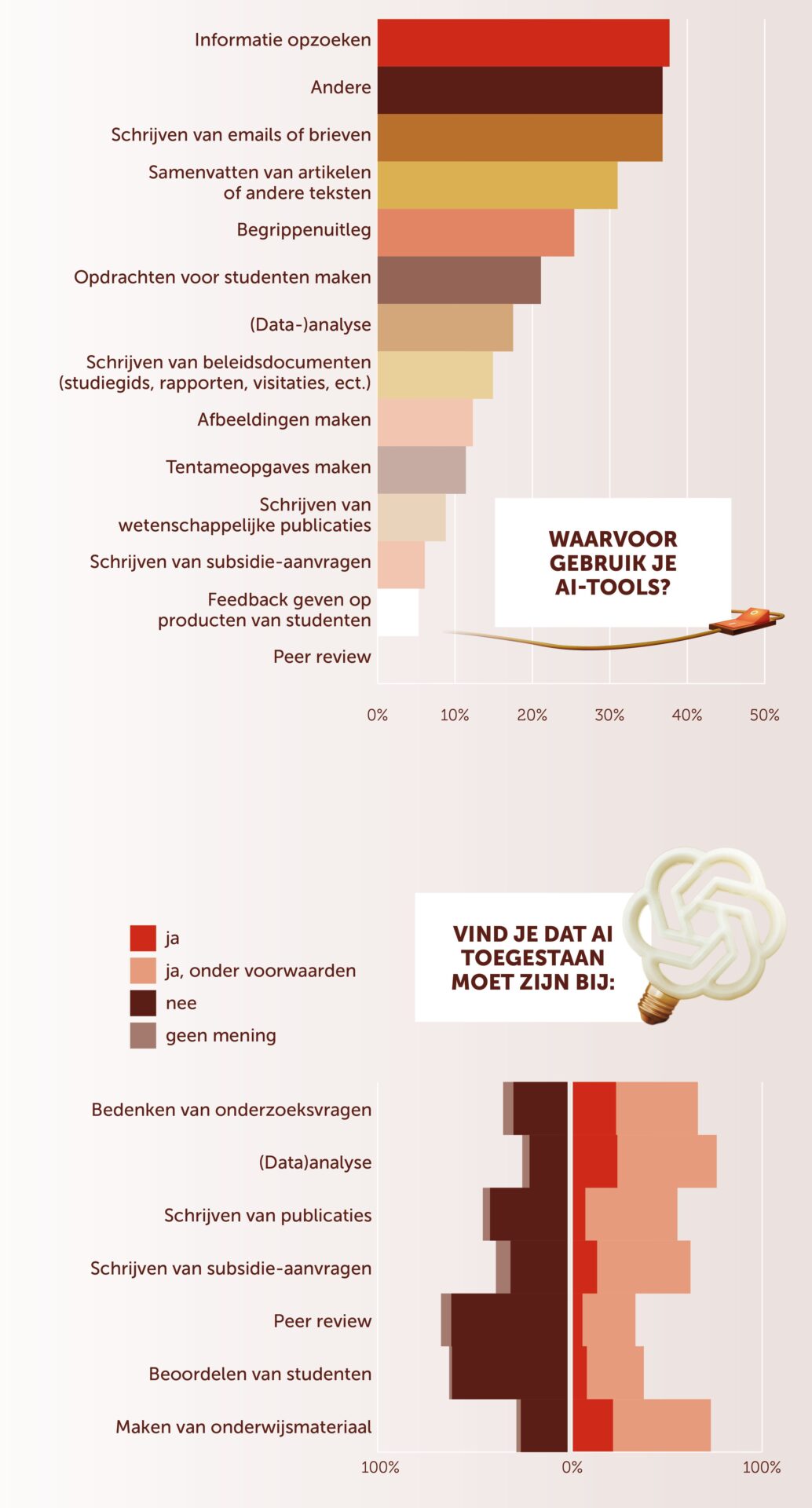

Wetenschappers gebruiken AI-tools voor vergelijkbare doeleinden. Een kwart tot een derde noemt het opzoeken van informatie, uitleg, samenvatten, maar ook administratieve taken zoals het schrijven van brieven, beleidsdocumenten of studiegidsteksten. ChatGPT is een volwaardige gesprekspartner ‘met ongelofelijk veel kennis en inzicht’, vindt een hoogleraar. ’Hoewel het net als mensen af en toe fouten maakt.’

Bijna een op de vijf wetenschappers laat ChatGPT opdrachten voor studenten maken. Ook voor spelling- en grammaticacontrole, vertalen en programmeercode schrijven gebruiken ze generatieve AI. ‘We hebben promovendi uit allerlei landen, die soms met de Engelse taal worstelen bij het schrijven van hun proefschrift’, licht natuurkundehoogleraar Nicolo de Groot, een enthousiast AI-gebruiker, desgevraagd toe. ‘Zij gebruiken ChatGPT om hun tekst te verbeteren.’ Zelf zet de voormalig vicedecaan onderwijs AI onder andere in bij het opstellen van tentamens. ‘Een van de opdrachten van het afgelopen tentamen was: stel deze vraag aan ChatGPT en bekijk kritisch of het antwoord klopt.’

Iris van Rooij ziet de omarming van AI door studenten en medewerkers juist met lede ogen aan. Als AI-hoogleraar is Van Rooij publiekelijk altijd zeer kritisch op wat ze de ’hype’ noemt van de tools die de grote techbedrijven ons voorschotelen. ‘Dat universiteiten hierin meegaan is zorgelijk.’ Je moet die überhaupt niet wíllen gebruiken, stelt ze: elke prompt die je invoert kost bakken met energie, LLM’s zijn getraind op teksten waar auteursrechten op zitten, en de onderliggende modellen zijn ontoegankelijk en dus oncontroleerbaar.

Maar bovenal vindt ze de ChatGPT’s van deze wereld desastreus voor de academische vorming. ‘Je eigen brein wordt uitgezet. Terwijl de universiteit er is om onafhankelijk en kritisch te leren denken.’ Samenvatten is bijvoorbeeld bij uitstek een analytische vaardigheid die je opdoet bij een academische opleiding, benadrukt ze. ‘Je beschouwt informatie door je persoonlijke cognitieve bril, waardoor je tot andere interessante inzichten komt dan iemand anders. Dat is waar wetenschap om draait.’ Gooi je alles door ChatGPT, dan krijg je eenheidsworst.

Detectiesoftware

Hoe gaan docenten om met het AI-gebruik van studenten? De helft van de docenten zegt dat studenten zouden profiteren van ongeoorloofd AI-gebruik in hun cursussen. Bijna driekwart controleert dit ook op een of andere manier, bijvoorbeeld door te letten op schrijfstijl en bronnengebruik. Slechts 5 procent gebruikt AI-detectiesoftware.

Ondanks de voordelen die studenten noemen, denken zij gemiddeld gesproken niet dat AI tot veel betere of juist slechtere studieresultaten leidt. Bijna allemaal zeggen ze ook zonder AI te kunnen, al zou een meerderheid de tools wel missen. Een masterstudent wijst erop dat ChatGPT de toegankelijkheid van onderwijs vergroot ‘voor mensen die traditioneel moeite hebben met schrijven zoals mensen met dyslexie.’

Opvallend is dat een op de negen respondenten nooit AI zegt te gebruiken. De onbetrouwbaarheid van de output die ChatGPT geeft is daarvoor de meest genoemde reden (een derde), al spelen overwegingen op het gebied van milieu en copyright ook een rol. Verder noemt 20 procent van de niet-gebruikers AI-gebruik valsspelen, en 12 procent is vooral bang betrapt te worden.

Opvallend is dat een op de negen respondenten nooit AI zegt te gebruiken. De onbetrouwbaarheid van de output die ChatGPT geeft is daarvoor de meest genoemde reden (een derde), al spelen overwegingen op het gebied van milieu en copyright ook een rol. Verder noemt 20 procent van de niet-gebruikers AI-gebruik valsspelen, en 12 procent is vooral bang betrapt te worden.

Betrouwbaarheid is ook een aandachtspunt onder studenten die wél ChatGPT gebruiken. Van hen controleren vijf van de zes geregeld de ‘antwoorden’ die ze krijgen. Een kwart zegt dat altijd te doen.

Duidelijkere regels

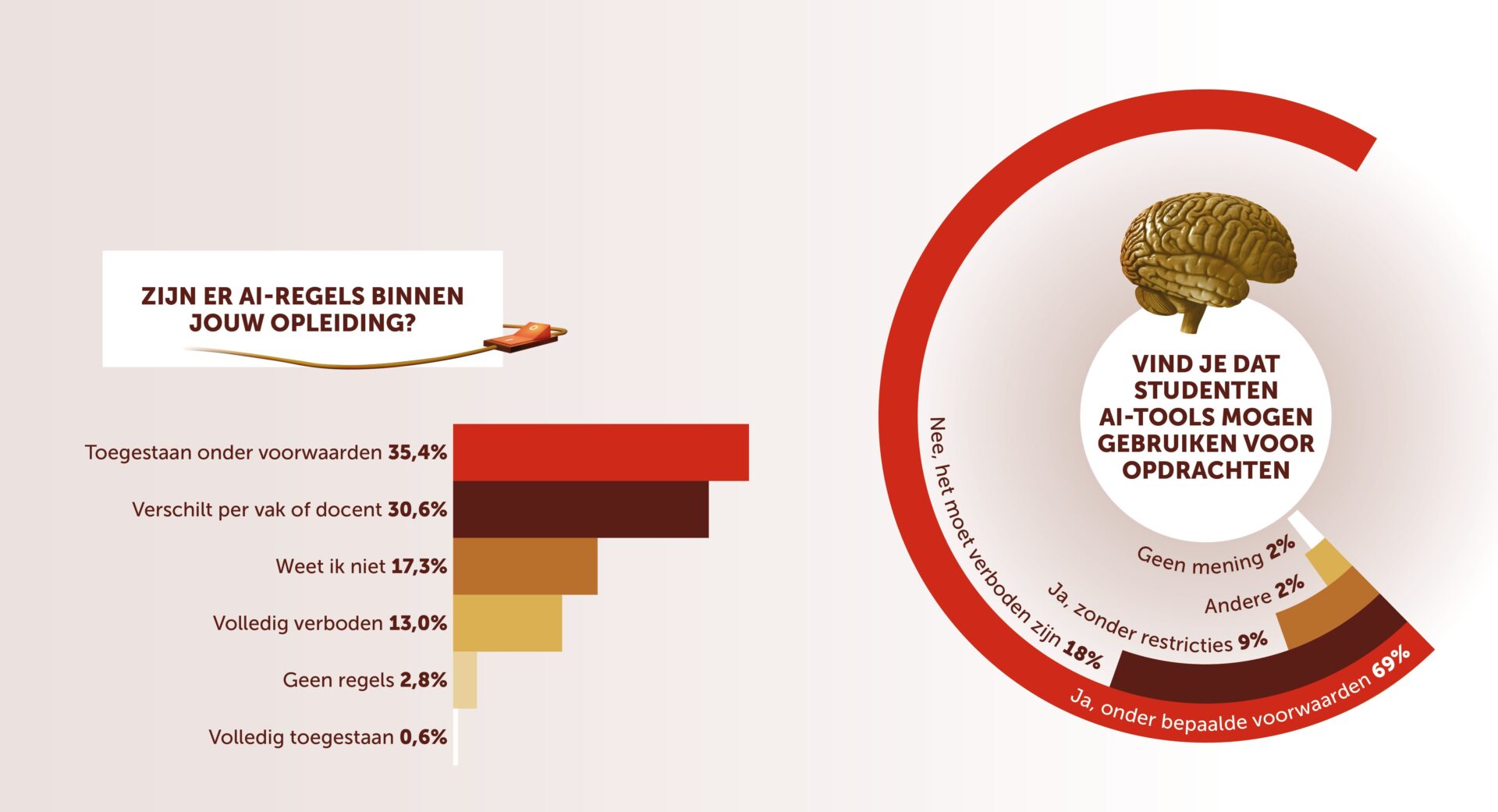

De behoefte aan regels is groot, vinden bijna alle studenten en medewerkers. Die moeten liefst op universitair of facultair niveau vastgesteld worden, als het aan de meerderheid van de docenten ligt. In hoeverre AI momenteel geoorloofd is varieert nogal, geven studenten aan. Waar het gebruik van AI in de ene cursus helemaal verboden is, wordt in de andere juist aangemoedigd om ermee te experimenteren. Docenten vinden de richtlijnen momenteel eerder te soepel (41 procent) dan te streng (15 procent).

‘Studenten moeten weten waar ze aan toe zijn’

Opvallend is dat een op de zes studenten aangeeft überhaupt niet te weten wat de AI-regels zijn binnen de eigen opleiding. Onder wetenschappers kruist zelfs ruim een derde dit antwoord aan. ‘De universiteit moet AI in de OER (de onderwijs- en examenregeling, red.) opnemen’, vindt een student. ‘Studenten moeten weten waar ze aan toe zijn.’

Wanneer de regels wél duidelijk zijn, lijken studenten die niet massaal te overtreden. Maar 5 procent doet dat zeer vaak, 15 procent soms. Slechts acht (van de 353) studenten zeggen ooit betrapt te zijn op ongeoorloofd AI-gebruik. Dat leidde tot een lager cijfer, onvoldoende, of melding bij de examencommissie.

Hoe die regels ook verder vorm krijgen, AI expliciet verbieden is volgens AI-hoogleraar Iris van Rooij niet de juiste weg. ‘We hebben al fraudenormen. Die kun je hier gewoon toepassen. Je mag bijvoorbeeld geen auteur- schap claimen als iemand anders een tekst heeft (mee) geschreven. Dat geldt dus ook voor ChatGPT, dat immers getraind is op het werk van anderen.’

Zelf merkt ze dat het helpt om studenten de keerzijdes van ChatGPT uit te leggen. ‘Dat vind ik ook de verantwoordelijkheid van docenten. Vaak hoor ik terug: waarom is ons dit nooit eerder verteld?’ Daarnaast laat ze studenten een verklaring tekenen waarin ze beloven alle opdrachten zelf te maken.

Kopieermachines

Hoe zit het eigenlijk bij wetenschappers? Wanneer mogen zij gebruikmaken van AI-tools? Bij data-analyses, schrijven van subsidieaanvragen en het maken van onderwijsmateriaal zijn AI-tools al dan niet onder voorwaarden aanvaardbaar, vindt een ruime meerderheid. ’We hebben kopieermachines, tekstverwerkers en internet toch ook omarmd?’, vraagt een respondent retorisch.

Over de hele linie denken wetenschappers dat AI positief uitpakt voor de onderzoekskwaliteit (7 op een 10-puntsschaal). Wel maken ze een duidelijk onderscheid tussen het type AI. Een taalmodel als ChatGPT heeft heel andere toepassingen dan AI-software die bijvoorbeeld röntgenfoto’s kan beoordelen of die een 3D-structuur van moleculen kan voorspellen zoals AlphaFold. Voor die laatste ‘die hard reken- en herkenningstaken kan AI in de vorm van machine learning extreem nuttig zijn’, benadrukt een respondent.

‘AI verandert hoe we dingen doen. Het zou niet goed zijn om dat buiten de universiteitsmuren te houden’

Wetenschappers staan een stuk negatiever tegenover het inzetten van AI bij academische kwaliteitsbeoordeling zoals evaluatie van studenten of wetenschappelijke manuscripten (peer review). Slechts 7,5 procent vindt dit zonder voorbehoud acceptabel. ’Ik ben […] tegen he gebruiken van generatieve AI voor het verwerken van die onderzoeksresultaten tot een artikel of andere tekstproducten’, licht een onderzoeker toe. ‘Dit zijn wat mij betreft vaardigheden die elke onderzoeker zelf moet bezitten.’

Toch is AI ook doorgedrongen tot het peer review-proces, schreef Nature onlangs. Het vakblad haalt een Franse ecoloog aan die in een reviewcommentaar de zin tegenkwam ‘Hier is een gereviseerde versie van je beoordeling met meer duidelijkheid en een betere structuur.’ Volgens een enquête van uitgeverijconcern Wiley gebruikt een op de vijf wetenschappers AI soms voor peer review. Critici vrezen een ‘echokamer’ waarin AI straks zowel het schrijven als het beoordelen van wetenschappelijke publicaties voor haar rekening neemt.

(Tekst gaat door onder de afbeelding)

Ook Van Rooij is, niet verrassend, fel tegenstander van het gebruik van commerciële, ondoorzichtige AI-tools in academisch onderzoek. Vanwege eerdergenoemde redenen, maar met name omdat ze vindt dat gebruik van bijvoorbeeld ChatGPT indruist tegen de wetenschappelijke integriteitscode. Die zegt immers dat wetenschap verifieerbaar en reproduceerbaar moet zijn. ‘Dat kan simpelweg niet als je ChatGPT inzet.’

Idealiter wil je dat Europa sterker wordt op AI-gebied en verantwoordere tools ontwikkelt, is Nicolo de Groot het met haar eens. Tegelijkertijd lijkt de vlucht die ChatGPT neemt niet tegen te houden. ‘AI verandert hoe we dingen doen. Het zou niet goed zijn om dat buiten de universiteitsmuren te houden.’

Denemarken

Vox’ vragenlijstonderzoek sluit, ondanks zijn beperkte omvang (zie kader), goed aan bij ander onderzoek. Zo deed wetenschapssocioloog Serge Horbach (FNWI) vorig jaar een vergelijkbare studie over gebruik van generatieve AI onder ruim 2.500 onderzoekers in Denemarken, waar hij destijds werkte. De studie verscheen onlangs in vakblad Technology in Society.

De ondervraagde Denen waren net als de Vox-respondenten opvallend positief over AI-gebruik in het algemeen, vertelt Horbach. ’Ze gebruiken het om meer en complexere analyses te doen, en bijvoorbeeld om de leesbaarheid van teksten te verbeteren en administratieve taken te verlichten.’

Tegelijkertijd was bijna iedereen zeer terughoudend als het gaat om AI-gebruik voor de essentiële aspecten van de wetenschap. Horbach: ‘Onderzoeksideeën genereren en peer review bijvoorbeeld. Dat laatste verbieden veel wetenschappelijke uitgevers overigens ook.’

Bewust van de gevaren

Precies die duidelijkheid ontbreekt momenteel aan de Radboud Universiteit, blijkt uit de enquêteresultaten. Maar achter de schermen werkt de universiteit wel degelijk aan beleid over het gebruik van generatieve AI. Al in 2023, toen er nog volop ‘paniek in de tent’ was, schreven beleidsmedewerkers en wetenschappers op verzoek van het college van bestuur een universitaire notitie. Tot gedetailleerde regels leidde dit echter niet. Faculteiten hebben eigen uitdagingen, was toen het idee. Wat een dilemma is op de ene plek, is dat op de andere plek minder.

Europese boetes

Om de risico’s van AI te beperken, is sinds augustus 2024 de AI-verordening van de Europese Unie van kracht. Deze wet verplicht bedrijven en organisaties om het gebruik van AI-tools onder medewerkers in kaart te brengen, mét de bijbehorende risico’s.

Organisaties die zich hier niet aan houden, riskeren boetes tot 35 miljoen euro. Daarom doet de Radboud Universiteit nog dit voorjaar een AI-vragenlijstonderzoek onder medewerkers en studenten.

Tegelijk werkt de universiteit aan een eigen online AI-register. Ook SURF, de ICT-coöperatie voor onderwijs en onderzoek, ontwikkelt momenteel een platform waar gebruikers een overzicht krijgen van verschillende open source AI-tools.

Verschillende faculteiten zoals letteren, sociale wetenschappen, managementwetenschappen en de medische faculteit hebben sindsdien eigen AI-richtlijnen opgesteld. Daarin staat telkens ongeveer dezelfde boodschap: het gebruik van AI is niet verboden, maar wees je bewust van de gevaren die erbij komen kijken en ga er heel kritisch mee om.

Inmiddels buigt een nieuwe stuurgroep zich in opdracht van het college van bestuur over universiteitsbrede regels. Beleidsmedewerker Jorn Bunk deelt zijn verwachtingen over de toekomstige richtlijnen. Verantwoord gebruik blijft het uitgangspunt, en dat gaat verder dan plagiaat en integriteit. ‘Publieke waarden zijn belangrijk, zoals duurzaamheid en de onafhankelijkheid van big tech. En uiteraard zullen opleidingen binnen dat verantwoorde gebruik de ruimte hebben om een verdere invulling te geven aan het gebruik van AI. Dat kan ook betekenen dat in meerdere situaties geen AI gebruikt mag worden.’ Daarnaast werkt de universiteit aan een AI-register, waarin voor alle tools de mogelijkheden en risico’s op een rij komen te staan (zie kader).

Ondertussen wil de universiteit nu al het gebruik van AI-tools door studenten en medewerkers strakker in de hand houden. Ze raadt aan om Microsoft365 CoPilot Chat te gebruiken in plaats van ChatGPT, omdat beveiliging van data daarin beter geregeld is. Of hier daadwerkelijk gehoor aan wordt gegeven, is maar de vraag. Van de Vox-respondenten gebruikt nagenoeg niemand deze tool.

Verantwoording

De twee online enquêtes stonden open van februari tot april. 353 studenten en 133 wetenschappers vulden ze in. 91 procent van de studenten was Nederlands, driekwart deed een bachelor. De sociale faculteit (41 procent) was oververtegenwoordigd, rechtenstudenten waren bijna afwezig (2 procent). Bij de wetenschappers waren promovendi en UD’s de grootste groep respondenten, gevolgd door hoogleraren, docenten en UHD’s. Een kwart had een andere functie.

Frank Kruijsbeek schreef op 22 mei 2025 om 17:14

De massale en volstrekt onkritische omarming van deze veredelde rekenmachines door zo veel wetenschappers is toch wel weer een schokkende ontmaskering van de opportunistische leegte waartoe hele velden van de hedendaagse wetenschap helaas neigen. Totale desinteresse in het letterlijke en figuurlijke restafval van de kennisproductie: ecologisch, ethisch, socio-economisch. De mentaliteit van misdadige bedrijven als Shell en Chemours maar dan voor data.

Gelukkig dat er óók nog mensen als Iris van Rooij zijn. Verademing.

Mark schreef op 23 mei 2025 om 09:32

Als het gaat om GenAI en onderzoek hebben sommige faculteiten wel degelijk helder beleid. Bij FdL en FFTR zijn bijvoorbeeld de volgende richtlijnen van kracht, gebaseerd op kernwaarden uit de Nederlandse Code of Conduct for Research Integrity: https://osf.io/preprints/osf/2c48n_v1